最近搜索

暂无搜索记录

热搜

JAVA

大数据

分布式

Python

人工智能

爬虫

WEB

JavaScript

认证

由于 DecisionTreeClassifier我查资料获得这是用CART算法构建的决策树,CART算法构建出来都是二叉树。

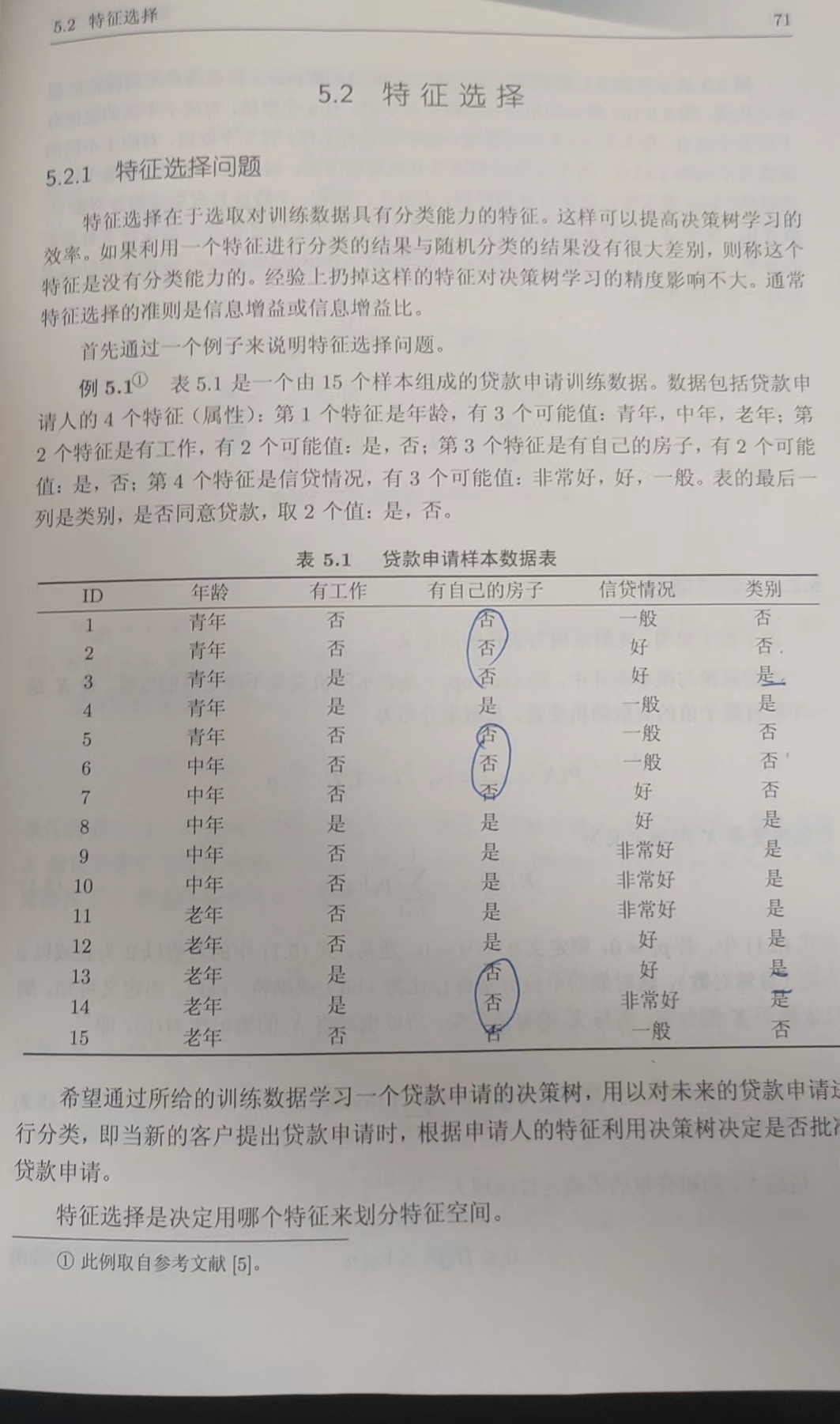

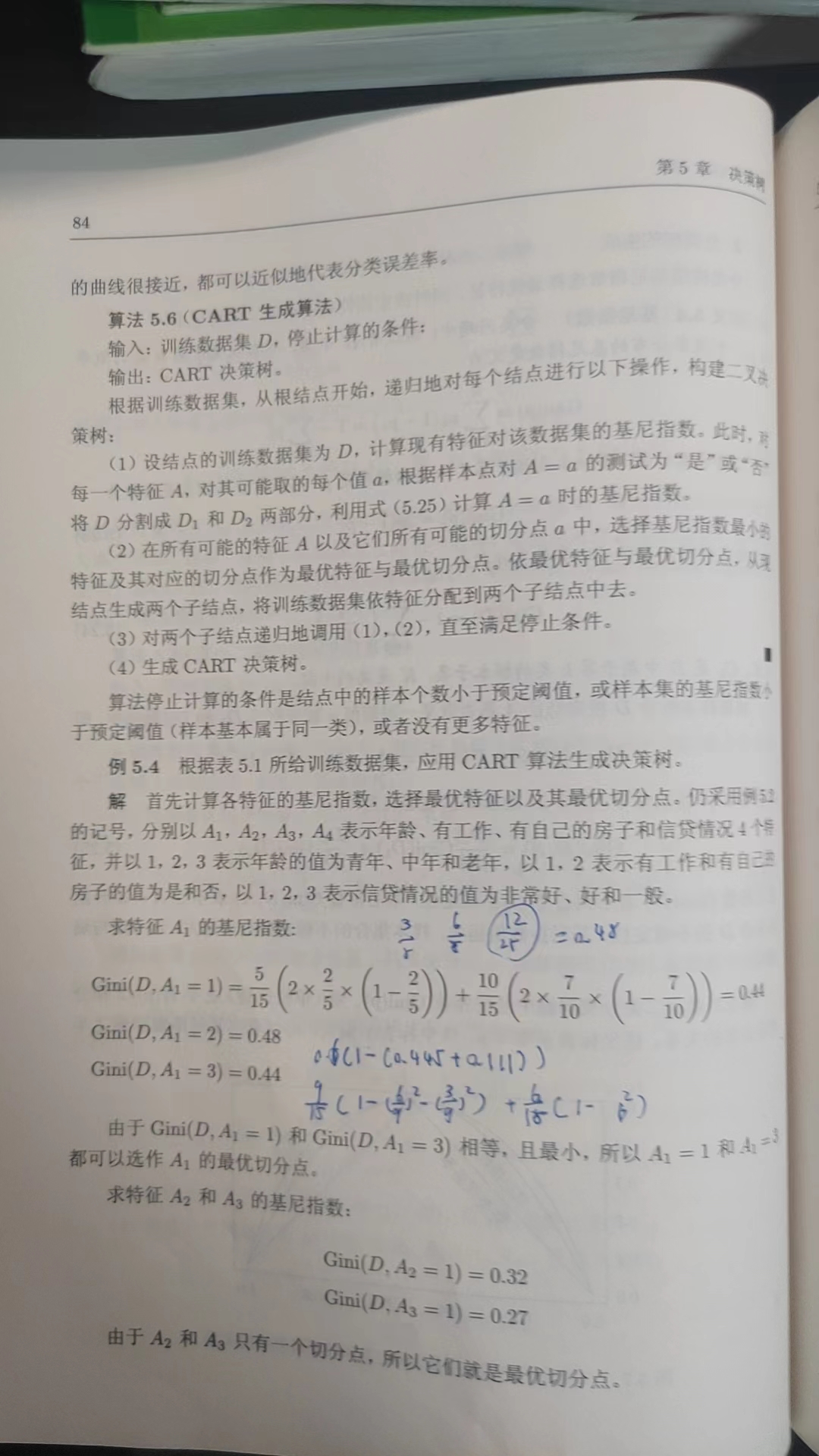

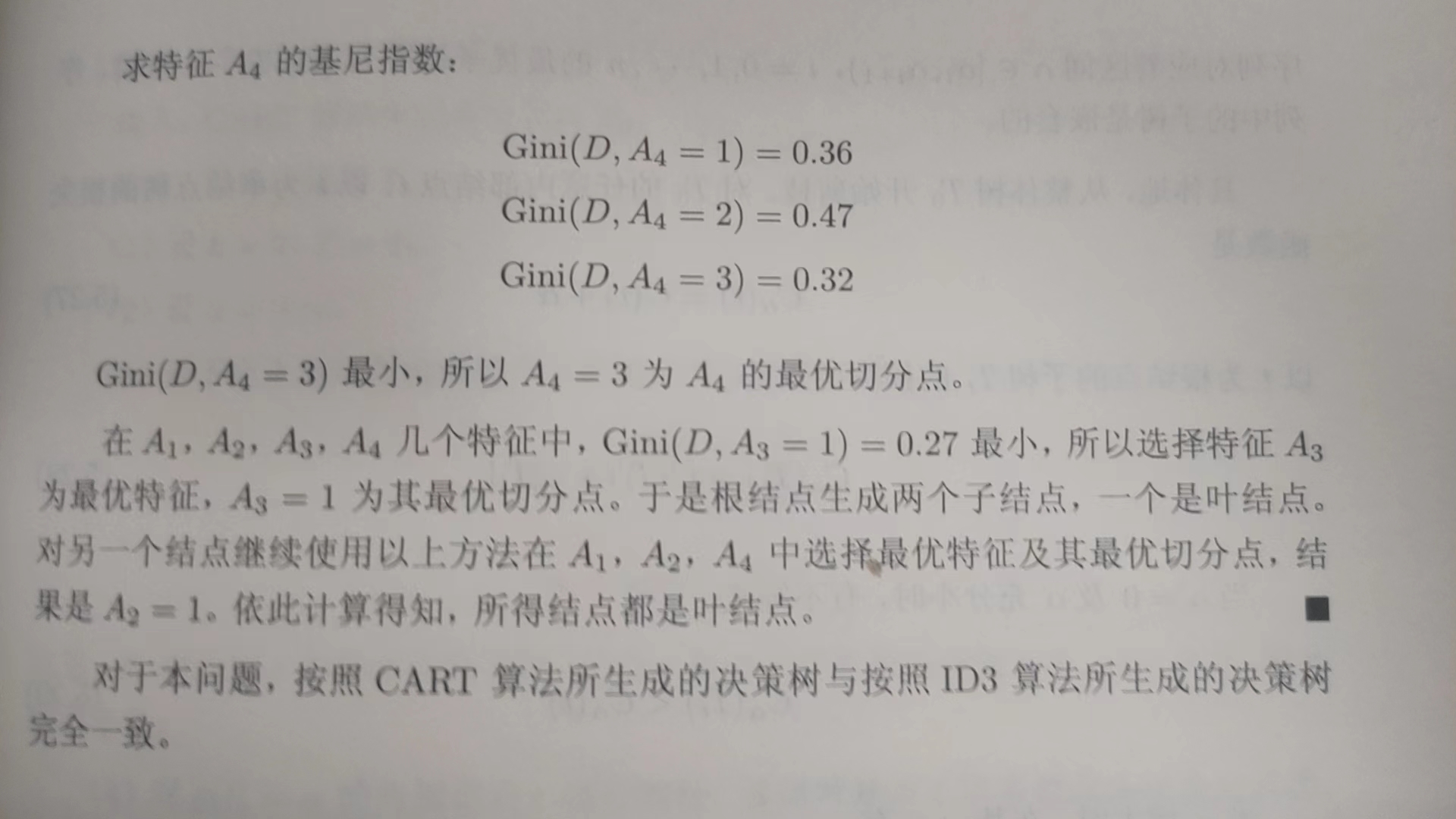

我去查询了统计学习方法(第二版)李航著其中介绍了CART算法如下

问题1:这本书上介绍CART算法时与老师代码中步骤有出入,请问是什么原因?

在这本书中介绍的CART算法对于某一列数据中可能会出现3个取值(如视频例子中好友密度的’s’‘l’‘m’,对于数值0,1,2)算基尼系数时Gini(D,A1=0)Gini(D,A1=1)Gini(D,A1=2)要计算3个基尼系数,但是老师的代码却是(如视频例子中好友密度的’s’‘l’‘m’,对于数值0,1,2)算基尼系数时是先0~1之间取均值0.5,1~2之间取均值1.5,计算Gini(D,A1=0.5)和Gini(D,A1=1.5)正如问题1,我不是很理解视频中老师为什么要这么操作以及python中输出的结果跟老师是一致的

问题二,既然 DecisionTreeClassifier是用CART算法,CART算法是基于基尼系数的,用信息熵是不是有点问题